Maskinlæring er formuleret som "minimeringsproblemer" af en tabsfunktion mod et givet sæt eksempler (træningssæt). Denne funktion udtrykker uoverensstemmelsen mellem de værdier, der er forudsagt af modellen, der trænes, og de forventede værdier for hvert eksempeleksempel.

Det endelige mål er at lære modellen evnen til at forudsige korrekt på et sæt tilfælde, der ikke er til stede i træningssættet.

En metode, hvorefter det er muligt at skelne mellem forskellige kategorier af algoritmer, er den type output, der forventes fra et bestemt system af machine learning.

Blandt de vigtigste kategorier finder vi:

Et eksempel på klassificering er tildelingen af en eller flere etiketter til et billede baseret på de objekter eller emner, der er indeholdt i det;

Et eksempel på regression er estimering af dybden af en scene fra dens repræsentation i form af et farvebillede.

Faktisk er domænet for det aktuelle output praktisk taget uendelig og ikke begrænset til et bestemt diskret sæt muligheder;

Lineær regression er ambredt anvendt model brugt til at estimere reelle værdier såsom:

og følger kriteriet for kontinuerlige variabler:

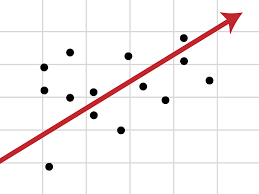

Ved lineær regression følges et forhold mellem uafhængige variabler og afhængige variabler gennem en linje, der normalt repræsenterer forholdet mellem de to variabler.

Passningslinien er kendt som regressionslinjen og er repræsenteret ved en lineær ligning af typen Y = a * X + b.

Formlen er baseret på interpolering af data for at knytte to eller flere egenskaber til hinanden. Når du giver algoritmen en inputkarakteristik, returnerer regressionen den anden egenskab.

Når vi har mere end en uafhængig variabel, taler vi om multiple lineær regression, idet vi antager en model som følgende:

y=b0 + b1x1 + b2x2 +… + Bnxn

Grundlæggende forklarer ligningen forholdet mellem en kontinuerlig afhængig variabel (y) og to eller flere uafhængige variabler (x1, x2, x3 ...).

Hvis vi for eksempel ville estimere CO2-emissionen fra en bil (afhængig variabel y) i betragtning af motoreffekten, antallet af cylindre og brændstofforbruget. Disse sidstnævnte faktorer er de uafhængige variabler x1, x2 og x3. Konstanterne bi er reelle tal og kaldes modelens estimerede regressionskoefficienter. Y er den kontinuerlige afhængige variabel, dvs. y vil være et reelt tal.

Multipel regressionsanalyse er en metode, der bruges til at identificere den effekt, som uafhængige variabler har på en afhængig variabel.

At forstå, hvordan den afhængige variabel ændres, når de uafhængige variabler ændres, giver os mulighed for at forudsige virkningerne eller virkningen af ændringer i reelle situationer.

Ved hjælp af multiple lineær regression er det muligt at forstå, hvordan blodtrykket ændrer sig, efterhånden som kropsmasseindekset ændrer sig med hensyn til faktorer som alder, køn osv., Således at man antager, hvad der kunne ske.

Med flere regression kan vi få estimater på prisudviklingen, såsom den fremtidige tendens for olie eller guld.

Endelig finder multipel lineær regression større interesse inden for maskinindlæring og kunstig intelligens, da det giver mulighed for at opnå udførende læringsmodeller, selv i tilfælde af et stort antal poster, der skal analyseres.

Logistisk regression er et statistisk værktøj, der sigter mod at modellere et binomialt resultat med en eller flere forklarende variabler.

Det bruges generelt til binære problemer, hvor der kun er to klasser, for eksempel Ja eller Nej, 0 eller 1, mand eller kvinde osv. ...

På denne måde er det muligt at beskrive dataene og forklare forholdet mellem en binær afhængig variabel og en eller flere uafhængige nominelle eller ordinale variabler.

Resultatet bestemmes takket være brugen af en logistisk funktion, som estimerer en sandsynlighed og derefter defiafslutter den nærmeste klasse (positiv eller negativ) til den opnåede sandsynlighedsværdi.

Vi kan betragte logistisk regression som en metode til klassificering af familien til overvåget indlæringsalgoritmer.

Ved hjælp af statistiske metoder tillader logistisk regression at generere et resultat, der faktisk repræsenterer en sandsynlighed for, at en given inputværdi hører til en given klasse.

I binomiale logistiske regressionsproblemer er sandsynligheden for, at output hører til den ene klasse P, mens det hører til den anden klasse 1-P (hvor P er et tal mellem 0 og 1, fordi det udtrykker en sandsynlighed).

Den binomiale logistiske regression fungerer godt i alle de tilfælde, hvor variablen vi forsøger at forudsige er binær, det vil sige, den kan kun tage to værdier: værdien 1, der repræsenterer den positive klasse, eller værdien 0, der repræsenterer den negative klasse.

Eksempler på problemer, der kan løses ved logistisk regression, er:

Med logistisk regression kan vi udføre forudsigelig analyse, måle forholdet mellem hvad vi ønsker at forudsige (afhængig variabel) og en eller flere uafhængige variabler, dvs. egenskaber. Sandsynlighedsestimering foretages gennem en logistisk funktion.

Sandsynlighederne omdannes efterfølgende til binære værdier, og for at gøre prognosen reel tildeles dette resultat den klasse, den tilhører, baseret på, om det er tæt på selve klassen eller ej.

For eksempel, hvis anvendelsen af den logistiske funktion returnerer 0,85, betyder det, at indgangen har genereret en positiv klasse ved at tildele den til klasse 1. Omvendt, hvis den havde opnået en værdi som 0,4 eller mere generelt <0,5 ..

Logistisk regression bruger den logistiske funktion til at evaluere klassificeringen af inputværdierne.

Den logistiske funktion, også kaldet sigmoid, er en kurve, der er i stand til at tage et hvilket som helst antal reelle værdier og kortlægge den til en værdi mellem 0 og 1, eksklusive ekstremer. Funktionen er:

hvor er det:

Logistisk regression bruger en ligning som en repræsentation, ligesom lineær regression

Indgangsværdierne (x) kombineres lineært ved hjælp af vægte eller koefficientværdier for at forudsige en outputværdi (y). En nøgleforskel fra lineær regression er, at den modellerede outputværdi er en binær værdi (0 eller 1) snarere end en numerisk værdi.

Her er et eksempel på en logistisk regressionsligning:

y = e^(b0 + b1 * x) / (1 + e^(b0 + b1 * x))

Hvor:

Hver kolonne i inputdataene har en tilknyttet b-koefficient (en konstant reel værdi), der skal læres fra træningsdataene.

Den faktiske repræsentation af modellen, som du vil gemme i hukommelsen eller en fil, er koefficienterne i ligningen (beta- eller b-værdien).

Logistisk regression modellerer sandsynligheden for standardklassen.

Lad os som et eksempel antage, at vi modellerer folks køn som mand eller kvinde fra deres højde, den første klasse kan være mand, og den logistiske regressionsmodel kan skrives som sandsynligheden for at være mand, hvis man får en persons højde eller mere. formelt:

P (køn = mand | højde)

Skrevet på en anden måde modellerer vi sandsynligheden for, at et input (X) tilhører klassen predefinite (Y = 1), kan vi skrive det som:

P(X) = P(Y = 1 | X)

Sandsynlighedsforudsigelsen skal transformeres til binære værdier (0 eller 1) for faktisk at lave en sandsynlighedsforudsigelse.

Logistisk regression er en lineær metode, men forudsigelser transformeres ved hjælp af den logistiske funktion. Virkningen heraf er, at vi ikke længere kan forstå forudsigelser som en lineær kombination af input, som vi kan med lineær regression, for eksempel ved at fortsætte ovenfra kan modellen udtrykkes som:

p(X) = e ^ (b0 + b1 * X) / (1 + e ^ (b0 + b1 * X))

Nu kan vi vende ligningen som følger. For at vende det kan vi fortsætte ved at fjerne e på den ene side ved at tilføje en naturlig logaritme på den anden side.

ln (p (X) / 1 - p (X)) = b0 + b1 * X

På denne måde får vi det faktum, at beregningen af output til højre er lineær igen (ligesom lineær regression), og input til venstre er en logaritme for sandsynligheden for standardklassen.

Sandsynlighederne beregnes som et forhold mellem sandsynligheden for begivenheden divideret med sandsynligheden for ingen begivenhed, f.eks. 0,8 / (1-0,8) hvis resultat er 4. Så vi kunne i stedet skrive:

ln(odds) = b0 + b1 *

Da sandsynligheder log-transformeres, kalder vi denne venstre-sidede log-odds eller probit.

Vi kan returnere eksponenten til højre og skrive den som:

sandsynlighed = e ^ (b0 + b1 * X)

Alt dette hjælper os til at forstå, at modellen faktisk stadig er en lineær kombination af input, men at denne lineære kombination refererer til log-sandsynligheder for præklassendefinita.

Koefficienterne (beta- eller b-værdier) for den logistiske regressionsalgoritme estimeres i indlæringsfasen. For at gøre dette bruger vi maksimal sandsynlighedsestimering.

Maksimal sandsynlighed estimering er en indlæringsalgoritme, der bruges af flere maskinlæringsalgoritmer. Koefficienterne fra modellen forudsiger en værdi meget tæt på 1 (f.eks. mand) for førskoleklassendefinite og en værdi meget tæt på 0 (f.eks. kvinde) for den anden klasse. Maksimal sandsynlighed for logistisk regression er en procedure til at finde værdier for koefficienter (Beta- eller ob-værdier), der minimerer fejlen i de sandsynligheder, der er forudsagt af modellen i forhold til dem i dataene (fx sandsynlighed 1, hvis dataene er den primære klasse) .

Vi bruger en minimeringsalgoritme til at optimere de bedste koefficientværdier for træningsdataene. Dette implementeres ofte i praksis ved hjælp af en effektiv numerisk optimeringsalgoritme.

Coveware by Veeam vil fortsætte med at levere responstjenester til cyberafpresning. Coveware vil tilbyde kriminaltekniske og afhjælpende funktioner...

Forudsigende vedligeholdelse revolutionerer olie- og gassektoren med en innovativ og proaktiv tilgang til anlægsstyring...

Det britiske CMA har udsendt en advarsel om Big Techs adfærd på markedet for kunstig intelligens. Der…

Dekretet om "grønne huse", der er formuleret af Den Europæiske Union for at øge bygningers energieffektivitet, har afsluttet sin lovgivningsproces med...