Maŝina lernado estas formulita kiel "minimumigaj problemoj" de perdo-funkcio kontraŭ donita aro de ekzemploj (trejnada aro). Ĉi tiu ĉefaĵo esprimas la discrepancon inter la valoroj antaŭdiritaj de la modelo trejnata kaj la atendataj valoroj por ĉiu ekzempla petskribo.

La fina celo estas instrui la modelon la kapablecon antaŭdiri ĝuste laŭ aro da kazoj ne ĉeestantaj en la trejnadaro.

Metodo laŭ kiu eblas distingi malsamajn kategoriojn de algoritmo estas la speco de eligo atendata de certa sistemo de maŝinlernado.

Inter la ĉefaj kategorioj ni trovas:

Ekzemplo de klasifiko estas la atribuo de unu aŭ pluraj etikedoj al bildo bazita sur la celoj aŭ subjektoj en ĝi;

Ekzemplo de regreso estas la takso de la profundo de sceno el ties reprezento en formo de kolora bildo.

Fakte, la regado de la eligo en demando estas preskaŭ senfina, kaj ne limigite al certa diskreta aro de eblecoj;

Lineara regreso estas amvaste uzata modelo uzata por taksi realajn valorojn kiel:

kaj sekvas la kriterio de kontinuaj variabloj:

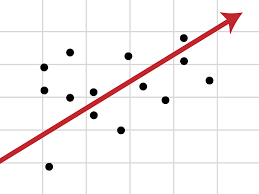

En lineara regreso, rilato inter sendependaj variabloj kaj dependaj variabloj estas sekvita tra linio kiu kutime reprezentas la rilaton inter la du variabloj.

La taŭga linio estas konata kiel la regresa linio kaj estas reprezentita per lineara ekvacio de la tipo Y = a * X + b.

La formulo baziĝas sur interpolado de datumoj por asocii du aŭ pli da trajtoj inter si. Kiam vi donas al la algoritmo enigaĵon, la regreso redonas la alian karakterizaĵon.

Kiam ni havas pli ol unu sendependan variablon, tiam ni parolas pri multobla lineara regreso, alprenante modelon kiel la sekvan:

y=b0 + b1x1 + b2x2 + ... + Bnxn

Esence la ekvacio klarigas la rilaton inter kontinua dependa variablo (y) kaj du aŭ pli sendependaj variabloj (x1, x2, x3 ...).

Ekzemple, se ni volis taksi la emision de CO2 de aŭto (dependa variablo y) konsiderante la potencon de la motoro, la nombron da cilindroj kaj konsumon de brulaĵo. Ĉi tiuj lastaj faktoroj estas la sendependaj variabloj x1, x2 kaj x3. La konstantoj bi estas reelaj nombroj kaj estas nomataj laŭ la taksitaj regresaj koeficientoj de la modelo.Y estas la kontinua dependa variablo, t.e. estante la sumo de b0, b1 x1, b2 x2, ktp. y estos vera nombro.

Analizo de multoblaj regresoj estas metodo uzata por identigi la efikon, kiun sendependaj variabloj havas sur dependa variablo.

Kompreni kiel la dependaj variabloj ŝanĝiĝas kiel la sendependaj variabloj permesas antaŭdiri la efikojn aŭ efikojn de ŝanĝoj en realaj situacioj.

Uzante multnombran linian regreson eblas kompreni kiel sangopremo ŝanĝiĝas, kiam la korpa mas-indico ŝanĝiĝas konsiderante faktorojn kiel aĝo, sekso, ktp, tiel supozante kio povus okazi.

Kun multobla regreso ni povas akiri taksojn pri prezoj, kiel la estonta tendenco de oleo aŭ oro.

Fine, multobla lineara regreso spertas pli grandan intereson en la kampo de maŝina lernado kaj artefarita inteligenteco, ĉar ĝi ebligas akiri plenumajn lernmodelojn eĉ en la kazo de granda nombro de registroj analizeblaj.

Logistika regreso estas statistika ilo, kiu celas modeligi binoman rezulton kun unu aŭ pluraj klarigaj variabloj.

Ĝi estas ĝenerale uzata por binaraj problemoj, kie estas nur du klasoj, ekzemple Jes aŭ Ne, 0 aŭ 1, vira aŭ virina ktp ...

Tiamaniere eblas priskribi la datumojn kaj klarigi la rilaton inter duuma dependa variablo kaj unu aŭ pluraj nominalaj aŭ ordinaraj sendependaj variabloj.

La rezulto estas determinita danke al la uzo de loĝistika funkcio, kiu taksas probablecon kaj poste defifinas la plej proksiman klason (pozitivan aŭ negativan) al la akirita probabla valoro.

Ni povas konsideri loĝistikan regreson kiel metodon por klasifiki la familion gvatita lernado algoritmoj.

Uzante statistikajn metodojn, loĝistika regreso permesas generi rezulton, kiu fakte reprezentas probablecon ke donita eniga valoro apartenas al donita klaso.

En binomiaj logistikaj regresaj problemoj, la probablo ke la eligo apartenas al unu klaso estos P, dum ke ĝi apartenas al la alia klaso 1-P (kie P estas nombro inter 0 kaj 1 ĉar ĝi esprimas probablon).

La binoma logistika regreso funkcias bone en ĉiuj tiuj kazoj, en kiuj la variablo, kiun ni provas antaŭdiri, estas duuma, tio estas nur kunpreni du valorojn: la valoron 1, kiu reprezentas la pozitivan klason, aŭ la valoron 0, kiu reprezentas la negativan klason.

Ekzemploj de problemoj, kiuj povas esti solvitaj per loĝistika regreso, estas:

Kun loĝistika regreso ni povas fari prognozan analizon, mezurante la rilaton inter tio, kion ni volas antaŭdiri (dependa variablo) kaj unu aŭ pluraj sendependaj variabloj, t.e. la trajtoj. Probabla takso estas farita per loĝistika funkcio.

La probabloj poste transformiĝas al binaraj valoroj, kaj por realigi la antaŭdiron, ĉi tiu rezulto estas asignita al la klaso al kiu ĝi apartenas, surbaze de ĉu ĝi estas proksima aŭ ne al la klaso mem.

Ekzemple, se la apliko de la loĝistika funkcio redonas 0,85, tiam ĝi signifas, ke la enigo generis pozitivan klason atribuante ĝin al klaso 1. Male, se ĝi akiris valoron kiel 0,4 aŭ pli ĝenerale <0,5 ..

Logistika regreso uzas la loĝistikan funkcion por taksi la klasifikon de la enigaj valoroj.

La logistika funkcio, ankaŭ nomata sigmoido, estas kurbo kapabla preni ĉian nombron de reala valoro kaj mapi ĝin al valoro inter 0 kaj 1, ekskludante ekstremojn. La funkcio estas:

kie ĝi estas:

Logistika regreso uzas ekvacion kiel reprezentadon, same kiel lineara regreso

La enigaj valoroj (x) estas lineare kombinitaj uzante pezojn aŭ koeficientajn valorojn, por antaŭdiri elirajn valorojn (y). Ŝlosila diferenco de lineara regreso estas, ke la modeligita elira valoro estas binara valoro (0 aŭ 1) prefere ol nombra valoro.

Sube estas ekzemplo de logistika regresa ekvacio:

y = e^(b0 + b1 * x) / (1 + e^(b0 + b1 * x))

Kolombo:

Ĉiu kolumno en la enigaj datumoj havas asocian b-koeficienton (konstantan realan valoron) kiu devas esti lernita de la trejnaj datumoj.

La efektiva reprezentado de la modelo, kiun vi stokus en memoro aŭ dosiero, estas la koeficientoj en la ekvacio (la valoro beta aŭ b).

Loĝista regreso modeligas la probablecon de la defaŭlta klaso.

Kiel ekzemplo, ni supozu, ke ni modeligas la sekson de homoj kiel masklo aŭ ino de sia alteco, la unua klaso povus esti vira, kaj la logistika regresa modelo povus esti skribita kiel la probablo de esti vira donita altecon de homo, aŭ pli. formale:

P (sekso = masklo | alteco)

Skribite alimaniere, ni modeligas la probablecon ke enigaĵo (X) apartenas al la klaso predefifinita (Y = 1), ni povas skribi ĝin kiel:

P(X) = P(Y = 1 | X)

La prognoza antaŭdiro devas esti transformita al binaraj valoroj (0 aŭ 1) por efektive fari probablecon.

Loĝista regreso estas lineara metodo, sed prognozoj transformiĝas uzante la loĝistikan funkcion. La efiko de tio estas, ke ni ne plu povas kompreni prognozojn kiel lineara kombinaĵo de enigaĵoj kiel ni povas kun lineara regreso, ekzemple, daŭrigante de supre, la modelo povas esprimi kiel:

p(X) = e ^ (b0 + b1 * X) / (1 + e ^ (b0 + b1 * X))

Nun ni povas reverti la ekvacion kiel sekvas. Por revertigi ĝin, ni povas procedi forigante la e-on unuflanke aldonante naturan logaritmon aliflanke.

ln (p (X) / 1 - p (X)) = b0 + b1 * X

Tiamaniere ni akiras la fakton, ke la komputado de la eligo dekstre estas lineara denove (same kiel lineara regreso), kaj la enigo maldekstre estas logaritmo de la probablo de la apriora klaso.

La probabloj estas kalkulitaj kiel rilatumo de la probablo de la evento dividita de la probablo de neniu evento, t.e. 0,8 / (1-0,8) kies rezulto estas 4. Do ni povus anstataŭe skribi:

ln (probableco) = b0 + b1 * X

Ĉar probabloj estas log-transformitaj, ni nomas ĉi-maldekstran log-odds aŭ probit.

Ni povas redoni la eksponenton dekstre kaj skribi ĝin kiel:

probablo = e ^ (b0 + b1 * X)

Ĉio ĉi helpas nin kompreni, ke efektive la modelo estas ankoraŭ lineara kombinaĵo de la enigaĵoj, sed ke ĉi tiu lineara kombinaĵo rilatas al la logprobabloj de la antaŭklaso.definita.

La koeficientoj (beta aŭ b valoroj) de la logistika regresiga algoritmo estas taksitaj en la lernada fazo. Por fari tion, ni uzas maksimuman verŝajnan taksadon.

Maksimuma verŝajna takso estas lernalgoritmo uzata de pluraj maŝinlernado-algoritmoj. La koeficientoj rezultiĝantaj el la modelo antaŭdiras valoron tre proksima al 1 (ekz. masklo) por la antaŭlerneja klasodefinita kaj valoro tre proksima al 0 (ekz. ina) por la alia klaso. Maksimuma verŝajneco por loĝistika regreso estas procedo trovi valorojn por koeficientoj (Beta aŭ ob-valoroj) kiuj minimumigas la eraron en la probabloj antaŭdiritaj de la modelo rilate al tiuj en la datumoj (ekz. probableco 1 se la datumoj estas la primara klaso) .

Ni uzos minimuman algoritmon por optimumigi la plej bonajn koeficientajn valorojn por la trejnaj datumoj. Ĉi tio ofte efektivigas praktike uzante efikan nombran optimuman algoritmon.

Pasintlunde, la Financial Times anoncis interkonsenton kun OpenAI. FT licencas sian mondklasan ĵurnalismon...

Milionoj da homoj pagas por streaming-servoj, pagante monatajn abonkotizojn. Estas komuna opinio, ke vi...

Coveware de Veeam daŭre liveros servojn de respondaj incidentoj pri ciberĉantaĝo. Coveware ofertos krimmedicinajn kaj solvajn kapablojn...

Prognoza prizorgado revolucias la petrolon kaj gasan sektoron, kun noviga kaj iniciatema aliro al plantadministrado...