Mašinų mokymasis yra suformuluotas kaip nuostolių funkcijos „minimizavimo problemos“ atsižvelgiant į pateiktą pavyzdžių rinkinį (mokymo rinkinį). Ši savybė išreiškia neatitikimą tarp vertinamų modelio numatomų verčių ir kiekvieno pavyzdžio tikėtinų verčių.

Pagrindinis tikslas yra išmokyti modelį sugebėti teisingai numatyti atvejus, kurių nėra treniruočių rinkinyje.

Metodas, pagal kurį galima atskirti skirtingas algoritmų kategorijas, yra išvesties tipas, kurio tikimasi iš tam tikros sistemos. mašininis mokymasis.

Tarp pagrindinių kategorijų, kurias randame:

Klasifikavimo pavyzdys yra vienos ar kelių etikečių priskyrimas atvaizdui pagal jame esančius objektus ar subjektus;

Regresijos pavyzdys yra scenos gylio įvertinimas nuo jos vaizdavimo spalvoto vaizdo pavidalu.

Iš tikrųjų aptariamo išėjimo sritis yra beveik begalinė ir neapsiriboja tam tikru diskrečiu galimybių rinkiniu;

Tiesinė regresija yraplačiai naudojamas modelis, naudojamas apskaičiuoti tikrąsias vertes, tokias kaip:

ir vadovaujasi nenutrūkstamų kintamųjų kriterijumi:

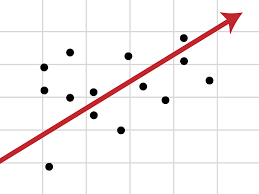

Linijinėje regresijoje santykis tarp nepriklausomų kintamųjų ir priklausomų kintamųjų sekamas per liniją, kuri paprastai parodo ryšį tarp dviejų kintamųjų.

Tinkama linija yra žinoma kaip regresijos linija ir pavaizduota tiesine Y = a * X + b tipo lygtimi.

Formulė yra pagrįsta duomenų interpoliavimu, kad būtų galima susieti dvi ar daugiau charakteristikų. Kai algoritmui pateikiate įvesties charakteristiką, regresija grąžina kitą charakteristiką.

Kai turime daugiau nei vieną nepriklausomą kintamąjį, mes kalbame apie daugialypę tiesinę regresiją, darant prielaidą, kad šis modelis yra toks:

y=b0 + b1x1 + b2x2 +… + Bnxn

Iš esmės lygtis paaiškina ryšį tarp ištisinio priklausomo kintamojo (y) ir dviejų ar daugiau nepriklausomų kintamųjų (x1, x2, x3…).

Pavyzdžiui, jei norėtume įvertinti automobilio išmetamo CO2 kiekį (priklausomas kintamasis y), atsižvelgiant į variklio galią, cilindrų skaičių ir degalų sąnaudas. Pastarieji veiksniai yra nepriklausomi kintamieji x1, x2 ir x3. Konstantos bi yra realieji skaičiai ir vadinami modelio apskaičiuotais regresijos koeficientais.Y yra nuolatinis priklausomas kintamasis, t. Y. B0, b1 x1, b2 x2 ir tt suma. y bus tikras skaičius.

Daugybinė regresinė analizė yra metodas, naudojamas nustatyti nepriklausomų kintamųjų poveikį priklausomam kintamajam.

Supratimas, kaip keičiasi priklausomas kintamasis, keičiantis nepriklausomiems kintamiesiems, leidžia mums numatyti pokyčių padarinius ar padarinius realiose situacijose.

Taikant daugybinę tiesinę regresiją, galima suprasti, kaip keičiasi kraujo spaudimas, keičiantis kūno masės indeksui, atsižvelgiant į tokius veiksnius kaip amžius, lytis ir pan., Taip darant prielaidą, kas galėtų nutikti.

Daugybine regresija galime gauti kainų tendencijų, tokių kaip būsima naftos ar aukso, tendencijas.

Galiausiai dėl daugialypės tiesinės regresijos atsiranda didesnis susidomėjimas mašininio mokymosi ir dirbtinio intelekto srityje, nes tai leidžia gauti atlikimo mokymosi modelius, net jei analizuojama daugybė įrašų.

Logistinė regresija yra statistinė priemonė, kuria siekiama modeliuoti dvinarį rezultatą vienu ar daugiau aiškinamųjų kintamųjų.

Paprastai jis naudojamas dvejetainėms problemoms spręsti, kai yra tik dvi klasės, pavyzdžiui, Taip arba Ne, 0 arba 1, vyras ar moteris ir tt.

Tokiu būdu galima aprašyti duomenis ir paaiškinti ryšį tarp dvejetainio priklausomo kintamojo ir vieno ar daugiau vardinių ar ordinarinių nepriklausomų kintamųjų.

Rezultatas nustatomas naudojant logistinę funkciją, kuri įvertina tikimybę ir tada defibaigiasi gautai tikimybės reikšmei artimiausia klasė (teigiama arba neigiama).

Logistinę regresiją galime laikyti šeimos klasifikavimo metodu prižiūrimi mokymosi algoritmai.

Taikant statistinius metodus, logistinė regresija leidžia generuoti rezultatą, kuris iš tikrųjų reiškia tikimybę, kad duota įvesties vertė priklauso tam tikrai klasei.

Esant binominėms logistinės regresijos problemoms, tikimybė, kad išėjimas priklauso vienai klasei, bus P, o kitai - 1-P klasei (kur P yra skaičius nuo 0 iki 1, nes jis išreiškia tikimybę).

Binominė logistinė regresija gerai veikia visais atvejais, kai kintamasis, kurį bandome nuspėti, yra dvejetainis, tai yra, jis gali prisiimti tik dvi reikšmes: reikšmė 1, kuri žymi teigiamą klasę, arba vertė 0, kuri žymi neigiamą klasę.

Problemų, kurias galima išspręsti taikant logistinę regresiją, pavyzdžiai:

Naudodamiesi logistine regresija, galime atlikti numatomąją analizę, išmatuodami ryšį tarp to, ką norime numatyti (priklausomas kintamasis) ir vieno ar daugiau nepriklausomų kintamųjų, t. Y. Charakteristikų. Tikimybių įvertinimas atliekamas naudojant logistinę funkciją.

Vėliau tikimybės paverčiamos dvejetainėmis reikšmėmis ir, kad prognozė būtų reali, šis rezultatas priskiriamas klasei, kuriai jis priklauso, remiantis tuo, ar ji artima pačiai klasei, ar ne.

Pvz., Jei logistinės funkcijos taikymas grąžina 0,85, tai reiškia, kad įvestis sukūrė teigiamą klasę, priskirdama ją 1 klasei. Priešingai, jei ji gavo tokią vertę kaip 0,4 arba apskritai <0,5 ..

Logistinė regresija naudoja logistinę funkciją įvesties verčių klasifikacijai įvertinti.

Logistinė funkcija, dar vadinama sigmoidine, yra kreivė, galinti paimti bet kokį realiosios vertės skaičių ir susieti jį su verte nuo 0 iki 1, neįskaitant kraštutinumų. Funkcija yra:

kur tai yra:

Logistinėje regresijoje lygtis naudojama kaip atvaizdavimas, panašiai kaip tiesinė regresija

Įvesties vertės (x) tiesiškai sujungiamos naudojant svorius ar koeficiento vertes, kad būtų galima numatyti išėjimo vertę (y). Pagrindinis skirtumas nuo tiesinės regresijos yra tas, kad modeliuojama išvesties vertė yra dvejetainė reikšmė (0 arba 1), o ne skaitinė vertė.

Čia pateiktas logistinės regresijos lygties pavyzdys:

y = e^(b0 + b1 * x) / (1 + e^(b0 + b1 * x))

Kur:

Kiekvienas įvesties duomenų stulpelis turi susietą b koeficientą (pastovią tikrąją vertę), kurį reikia išmokti iš mokymo duomenų.

Faktinis modelio, kurį išsaugotumėte atmintyje ar faile, pavaizdavimas yra lygties koeficientai (beta arba b vertė).

Logistinė regresija modeliuoja numatytosios klasės tikimybę.

Tarkime, kad mes modeliuojame žmonių lytį kaip vyrišką ar moterišką pagal jų ūgį, pirmoji klasė galėtų būti vyriška, o logistinės regresijos modelį galima būtų surašyti kaip tikimybę būti vyru atsižvelgiant į asmens ūgį ar daugiau. oficialiai:

P (lytis = vyras | ūgis)

Parašyta kitaip, modeliuojame tikimybę, kad įvestis (X) priklauso klasei predefinite (Y = 1), galime parašyti taip:

P(X) = P(Y = 1 | X)

Tikimybės numatymą reikia paversti dvejetainėmis reikšmėmis (0 arba 1), kad būtų galima numatyti tikimybę.

Logistinė regresija yra tiesinis metodas, tačiau prognozės transformuojamos naudojant logistinę funkciją. To pasekmė yra tai, kad mes nebegalime suprasti prognozių kaip linijinio įvesties derinio, nes galime, pavyzdžiui, esant tiesinei regresijai, pavyzdžiui, tęsiant iš viršaus, modelį galima išreikšti taip:

p(X) = e ^ (b0 + b1 * X) / (1 + e ^ (b0 + b1 * X))

Dabar lygtį galime pakeisti taip. Norėdami tai pakeisti, galime tęsti pašalindami e iš vienos pusės pridėdami natūralų logaritmą iš kitos pusės.

ln (p (X) / 1 - p (X)) = b0 + b1 * X

Tokiu būdu gauname faktą, kad išvesties skaičiavimas dešinėje vėl yra tiesinis (kaip ir tiesinė regresija), o kairėje įvestis yra numatytosios klasės tikimybės logaritmas.

Tikimybės apskaičiuojamos kaip įvykio tikimybės santykis, padalytas iš įvykio neįvykdymo tikimybės, pvz. 0,8 / (1-0,8), kurio rezultatas yra 4. Taigi mes vietoj to galėtume parašyti:

ln (šansai) = b0 + b1 * X

Kadangi tikimybės yra transformuotos log, tai vadiname kairiosiomis log-odds arba probit.

Mes galime grąžinti eksponentą į dešinę ir parašyti taip:

tikimybė = e ^ (b0 + b1 * X)

Visa tai padeda suprasti, kad iš tiesų modelis vis dar yra linijinis įvesties derinys, tačiau šis tiesinis derinys nurodo išankstinės klasės logines tikimybes.definita.

Logistinės regresijos algoritmo koeficientai (beta arba b vertės) įvertinami mokymosi etape. Norėdami tai padaryti, naudojame didžiausios tikimybės įvertinimą.

Didžiausios tikimybės įvertinimas yra mokymosi algoritmas, kurį naudoja keli mašininio mokymosi algoritmai. Iš modelio gauti koeficientai numato ikimokyklinės klasės vertę, labai artimą 1 (pvz., vyrų).definite, o kitos klasės vertė yra labai artima 0 (pvz., moteriška). Didžiausia logistinės regresijos tikimybė – tai koeficientų verčių (Beta arba ob reikšmių) radimo procedūra, kuri sumažina modelio numatytų tikimybių paklaidą, palyginti su tomis, kurios yra duomenyse (pvz., 1 tikimybė, jei duomenys yra pirminė klasė). .

Mes naudosime minimizavimo algoritmą, kad optimizuotume geriausias treniruočių duomenų koeficiento vertes. Tai dažnai įgyvendinama praktikoje naudojant efektyvų skaitmeninio optimizavimo algoritmą.

Lavindami smulkiosios motorikos įgūdžius dažydami, vaikai paruošiami sudėtingesniems įgūdžiams, pavyzdžiui, rašymui. Norėdami nuspalvinti…

Karinio jūrų laivyno sektorius yra tikra pasaulinė ekonominė galia, kuri pasiekė 150 mlrd.

Praėjusį pirmadienį „Financial Times“ paskelbė apie susitarimą su „OpenAI“. FT licencijuoja savo pasaulinio lygio žurnalistiką…

Milijonai žmonių moka už srautinio perdavimo paslaugas, mokėdami mėnesinius abonentinius mokesčius. Paplitusi nuomonė, kad jūs…