Maskinlæring er formulert som "minimeringsproblemer" av en tapsfunksjon mot et gitt sett med eksempler (treningssett). Denne funksjonen uttrykker avviket mellom verdiene som er spådd av modellen som blir trent og de forventede verdiene for hvert eksempel.

Det endelige målet er å lære modellen muligheten til å forutsi riktig på et sett tilfeller som ikke er tilstede i treningssettet.

En metode der det er mulig å skille forskjellige kategorier av algoritmer er typen utdata som forventes fra et bestemt system av maskinlæring.

Blant hovedkategoriene finner vi:

Et eksempel på klassifisering er tildelingen av en eller flere etiketter til et bilde basert på objektene eller emnene i den;

Et eksempel på regresjon er estimering av dybden til en scene fra dens representasjon i form av et fargebilde.

Faktisk er domenet til den aktuelle utdata praktisk talt uendelig, og ikke begrenset til et visst diskret sett med muligheter;

Lineær regresjon er ammye brukt modell brukt til å estimere reelle verdier som:

og følger kriteriet om kontinuerlige variabler:

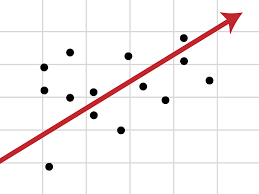

Ved lineær regresjon følges et forhold mellom uavhengige variabler og avhengige variabler gjennom en linje som vanligvis representerer forholdet mellom de to variablene.

Passingslinjen er kjent som regresjonslinjen og er representert ved en lineær ligning av typen Y = a * X + b.

Formelen er basert på å interpolere data for å knytte to eller flere kjennetegn til hverandre. Når du gir algoritmen en inngangskarakteristikk, returnerer regresjonen den andre karakteristikken.

Når vi har mer enn en uavhengig variabel, snakker vi om multippel lineær regresjon, forutsatt en modell som følgende:

y=b0 + B1x1 + B2x2 +… + Bnxn

I praksis forklarer ligningen forholdet mellom en kontinuerlig avhengig variabel (y) og to eller flere uavhengige variabler (x1, x2, x3 ...).

Hvis vi for eksempel ville estimere CO2-utslippet fra en bil (avhengig variabel y) med tanke på motoreffekten, antall sylindere og drivstofforbruk. Disse sistnevnte faktorene er de uavhengige variablene x1, x2 og x3. Konstantene bi er reelle tall og kalles modellens estimerte regresjonskoeffisienter. Y er den kontinuerlige avhengige variabelen, dvs. å være summen av b0, b1 x1, b2 x2, etc. y vil være et reelt tall.

Multiple regresjonsanalyser er en metode som brukes til å identifisere effekten som uavhengige variabler har på en avhengig variabel.

Å forstå hvordan den avhengige variabelen endres etter hvert som de uavhengige variablene endrer, gjør at vi kan forutsi effekter eller virkninger av endringer i reelle situasjoner.

Ved å bruke multippel lineær regresjon er det mulig å forstå hvordan blodtrykket endrer seg når kroppsmasseindeksen endres med tanke på faktorer som alder, kjønn, etc., og antar dermed hva som kan skje.

Med flere regresjoner kan vi få estimater på prisutviklinger, for eksempel den fremtidige trenden for olje eller gull.

Endelig er multippel lineær regresjon å finne større interesse for feltet maskinlæring og kunstig intelligens, ettersom det gjør det mulig å oppnå utførende læringsmodeller selv i tilfelle et stort antall poster som skal analyseres.

Logistisk regresjon er et statistisk verktøy som tar sikte på å modellere et binomialt resultat med en eller flere forklaringsvariabler.

Det brukes vanligvis til binære problemer, der det bare er to klasser, for eksempel Ja eller Nei, 0 eller 1, mann eller kvinne osv ...

På denne måten er det mulig å beskrive dataene og forklare forholdet mellom en binæravhengig variabel og en eller flere nominelle eller ordinære uavhengige variabler.

Resultatet bestemmes takket være bruken av en logistisk funksjon, som estimerer en sannsynlighet og deretter defiavslutter den nærmeste klassen (positiv eller negativ) til den oppnådde sannsynlighetsverdien.

Vi kan betrakte logistisk regresjon som en metode for å klassifisere familien til veiledet læringsalgoritmer.

Ved bruk av statistiske metoder tillater logistisk regresjon å generere et resultat som faktisk representerer en sannsynlighet for at en gitt inngangsverdi tilhører en gitt klasse.

I binomiale logistiske regresjonsproblemer vil sannsynligheten for at utgangen tilhører en klasse være P, mens den tilhører den andre klassen 1-P (der P er et tall mellom 0 og 1 fordi det uttrykker en sannsynlighet).

Den binomiale logistiske regresjonen fungerer bra i alle de tilfeller der variabelen vi prøver å forutsi er binær, det vil si at den bare kan ta to verdier: verdien 1 som representerer den positive klassen, eller verdien 0 som representerer den negative klassen.

Eksempler på problemer som kan løses ved logistisk regresjon er:

Med logistisk regresjon kan vi gjøre prediktiv analyse, måle forholdet mellom det vi ønsker å forutsi (avhengig variabel) og en eller flere uavhengige variabler, dvs. karakteristikkene. Sannsynlighetsestimering gjøres gjennom en logistisk funksjon.

Sannsynlighetene blir deretter transformert til binære verdier, og for å gjøre prediksjonen reell blir dette resultatet tilordnet klassen den tilhører, basert på om den ligger i nærheten av klassen selv eller ikke.

For eksempel, hvis anvendelsen av logistikkfunksjonen returnerer 0,85, betyr det at inngangen genererte en positiv klasse ved å tilordne den til klasse 1. Omvendt hvis den hadde fått en verdi som 0,4 eller mer generelt <0,5 ..

Logistisk regresjon bruker logistikkfunksjonen til å evaluere klassifiseringen av inngangsverdiene.

Den logistiske funksjonen, også kalt sigmoid, er en kurve som kan ta et hvilket som helst antall reell verdi og kartlegge den til en verdi mellom 0 og 1, unntatt ytterligheter. Funksjonen er:

der:

Logistisk regresjon bruker en ligning som representasjon, omtrent som lineær regresjon

Inngangsverdiene (x) kombineres lineært ved bruk av vekter eller koeffisientverdier for å forutsi en utgangsverdi (y). En viktig forskjell fra lineær regresjon er at den modellerte utgangsverdien er en binær verdi (0 eller 1) i stedet for en numerisk verdi.

Her er et eksempel på en logistisk regresjonsligning:

y = e^(b0 + b1 * x) / (1 + e^(b0 + b1 * x))

Hvor:

Hver kolonne i inndatadataene har en tilknyttet b-koeffisient (en konstant reell verdi) som må læres av treningsdataene.

Selve representasjonen av modellen som du vil lagre i minnet eller en fil er koeffisientene i ligningen (beta- eller b-verdien).

Logistisk regresjon modellerer sannsynligheten for standardklassen.

La oss som et eksempel anta at vi modellerer folks kjønn som mann eller kvinne fra deres høyde, den første klassen kan være mannlig, og den logistiske regresjonsmodellen kan skrives som sannsynligheten for å være mannlig gitt en persons høyde, eller mer. formelt:

P (kjønn = mannlig | høyde)

Skrevet på en annen måte modellerer vi sannsynligheten for at en inngang (X) tilhører klassen predefinite (Y = 1), kan vi skrive det som:

P(X) = P(Y = 1 | X)

Sannsynlighetsforutsigelsen må transformeres til binære verdier (0 eller 1) for å faktisk lage en sannsynlighetsprediksjon.

Logistisk regresjon er en lineær metode, men prediksjoner transformeres ved hjelp av den logistiske funksjonen. Effekten av dette er at vi ikke lenger kan forstå spådommer som en lineær kombinasjon av innganger som vi kan med lineær regresjon, for eksempel hvis vi fortsetter ovenfra, kan modellen uttrykkes som:

p(X) = e ^ (b0 + b1 * X) / (1 + e ^ (b0 + b1 * X))

Nå kan vi snu likningen som følger. For å reversere det kan vi fortsette ved å fjerne e på den ene siden ved å legge til en naturlig logaritme på den andre siden.

ln (p (X) / 1 - p (X)) = b0 + b1 * X

På denne måten får vi det faktum at beregningen av utgangen til høyre er lineær igjen (akkurat som lineær regresjon), og inngangen til venstre er en logaritme for sannsynligheten for standardklassen.

Sannsynlighetene beregnes som et forhold mellom sannsynligheten for hendelsen delt på sannsynligheten for ingen hendelse, f.eks. 0,8 / (1-0,8) hvis resultat er 4. Så vi kunne i stedet skrevet:

ln(odds) = b0 + b1 *

Siden sannsynligheter er loggtransformert, kaller vi dette venstre-sidige log-odds eller probit.

Vi kan returnere eksponenten til høyre og skrive den som:

sannsynlighet = e ^ (b0 + b1 * X)

Alt dette hjelper oss å forstå at modellen fortsatt er en lineær kombinasjon av inngangene, men at denne lineære kombinasjonen refererer til logsannsynlighetene til preklassendefinita.

Koeffisientene (beta- eller b-verdiene) for den logistiske regresjonsalgoritmen er estimert i læringsfasen. For å gjøre dette bruker vi maksimal sannsynlighetsestimering.

Maksimal sannsynlighetsestimering er en læringsalgoritme som brukes av flere maskinlæringsalgoritmer. Koeffisientene som følger av modellen forutsier en verdi veldig nær 1 (f.eks. mann) for førskoleklassendefinite og en verdi veldig nær 0 (f.eks. kvinne) for den andre klassen. Maksimal sannsynlighet for logistisk regresjon er en prosedyre for å finne verdier for koeffisienter (Beta- eller ob-verdier) som minimerer feilen i sannsynlighetene predikert av modellen i forhold til de i dataene (f.eks. sannsynlighet 1 hvis dataene er primærklassen) .

Vi vil bruke en minimeringsalgoritme for å optimalisere de beste koeffisientverdiene for treningsdataene. Dette implementeres ofte i praksis ved bruk av en effektiv numerisk optimaliseringsalgoritme.

Sist mandag kunngjorde Financial Times en avtale med OpenAI. FT lisensierer sin journalistikk i verdensklasse...

Millioner av mennesker betaler for strømmetjenester og betaler månedlige abonnementsavgifter. Det er vanlig oppfatning at du...

Coveware by Veeam vil fortsette å tilby responstjenester for cyberutpressing. Coveware vil tilby kriminaltekniske og utbedringsmuligheter...

Prediktivt vedlikehold revolusjonerer olje- og gasssektoren, med en innovativ og proaktiv tilnærming til anleggsledelse...