Maskininlärning är formulerad som "minimeringsproblem" av en förlustfunktion mot en given uppsättning exempel (träningsuppsättning). Denna funktion uttrycker skillnaden mellan de värden som förutses av modellen som tränas och de förväntade värdena för varje exempelinstans.

Det slutliga målet är att lära modellen förmågan att förutsäga korrekt på en uppsättning instanser som inte finns i träningsuppsättningen.

En metod enligt vilken det är möjligt att särskilja olika kategorier av algoritmer är den typ av utdata som förväntas från ett visst system av maskininlärning.

Bland huvudkategorierna hittar vi:

Ett exempel på klassificering är tilldelningen av en eller flera etiketter till en bild baserad på de objekt eller motiv som finns i den;

Ett exempel på regression är uppskattningen av djupet på en scen från dess representation i form av en färgbild.

I själva verket är domänen för den aktuella utgången praktiskt taget oändlig och inte begränsad till en viss diskret uppsättning möjligheter;

Linjär regression är amallmänt använt modell som används för att uppskatta verkliga värden som:

och följer kriteriet för kontinuerliga variabler:

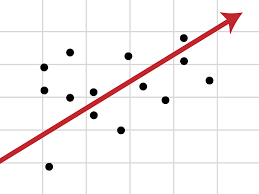

Vid linjär regression följs en relation mellan oberoende variabler och beroende variabler genom en linje som vanligtvis representerar förhållandet mellan de två variablerna.

Passningslinjen kallas regressionslinjen och representeras av en linjär ekvation av typen Y = a * X + b.

Formeln är baserad på interpolering av data för att associera två eller flera egenskaper med varandra. När du ger algoritmen en inmatningskarakteristik returnerar regressionen den andra karakteristiken.

När vi har mer än en oberoende variabel, talar vi om multipel linjär regression och antar en modell som följande:

y=b0 + B.1x1 + B.2x2 +… + Bnxn

I praktiken förklarar ekvationen förhållandet mellan en kontinuerlig beroende variabel (y) och två eller flera oberoende variabler (x1, x2, x3 ...).

Om vi till exempel ville beräkna CO2-utsläppet från en bil (beroende variabel y) med tanke på motoreffekten, antalet cylindrar och bränsleförbrukningen. Dessa senare faktorer är de oberoende variablerna x1, x2 och x3. Konstanterna bi är verkliga siffror och kallas modellens uppskattade regressionskoefficienter. Y är den kontinuerliga beroende variabeln, dvs. y kommer att vara ett riktigt antal.

Multipel regressionsanalys är en metod som används för att identifiera effekten som oberoende variabler har på en beroende variabel.

Att förstå hur den beroende variabelen ändras när de oberoende variablerna ändras gör att vi kan förutsäga effekterna eller effekterna av förändringar i verkliga situationer.

Med hjälp av multipel linjär regression är det möjligt att förstå hur blodtrycket förändras när kroppsmassaindexet förändras med tanke på faktorer som ålder, kön etc., och därmed utgå från vad som kan hända.

Med flera regression kan vi få uppskattningar av prisutvecklingen, till exempel den framtida trenden för olja eller guld.

Slutligen upptäcker multipel linjär regression ett större intresse inom området maskininlärning och artificiell intelligens, eftersom det gör det möjligt att erhålla utförande inlärningsmodeller även om ett stort antal poster ska analyseras.

Logistisk regression är ett statistiskt verktyg som syftar till att modellera ett binomialt resultat med en eller flera förklarande variabler.

Det används vanligtvis för binära problem, där det bara finns två klasser, till exempel Ja eller Nej, 0 eller 1, hane eller kvinna osv ...

På detta sätt är det möjligt att beskriva data och förklara förhållandet mellan en binärberoende variabel och en eller flera oberoende nominella eller ordinära variabler.

Resultatet bestäms tack vare användningen av en logistisk funktion, som uppskattar en sannolikhet och sedan defislutar den klass som ligger närmast (positiv eller negativ) till det erhållna sannolikhetsvärdet.

Vi kan betrakta logistisk regression som en metod för att klassificera familjen till övervakade inlärningsalgoritmer.

Med hjälp av statistiska metoder tillåter logistisk regression att generera ett resultat som i själva verket representerar en sannolikhet för att ett givet ingångsvärde tillhör en given klass.

I binomiala logistiska regressionsproblem är sannolikheten för att utgången tillhör en klass, medan den tillhör den andra klass 1-P (där P är ett tal mellan 0 och 1 eftersom det uttrycker en sannolikhet).

Den binomiala logistiska regressionen fungerar bra i alla de fall där variabeln vi försöker förutsäga är binär, det vill säga den kan endast ta två värden: värdet 1 som representerar den positiva klassen, eller värdet 0 som representerar den negativa klassen.

Exempel på problem som kan lösas genom logistisk regression är:

Med logistisk regression kan vi göra prediktiv analys, mäta förhållandet mellan vad vi vill förutsäga (beroende variabel) och en eller flera oberoende variabler, dvs egenskaper. Uppskattning av sannolikheten görs genom en logistisk funktion.

Sannolikheterna omvandlas därefter till binära värden, och för att göra förutsägelsen verklig tilldelas detta resultat den klass det tillhör, baserat på om det är nära klassen själv eller inte.

Till exempel, om tillämpningen av den logistiska funktionen returnerar 0,85, betyder det att ingången genererade en positiv klass genom att tilldela den till klass 1. Omvänt om den hade fått ett värde som 0,4 eller mer generellt <0,5 ..

Logistisk regression använder logistikfunktionen för att utvärdera klassificeringen av ingångsvärdena.

Den logistiska funktionen, även kallad sigmoid, är en kurva som kan ta valfritt antal verkliga värden och kartlägga det till ett värde mellan 0 och 1, exklusive ytterligheter. Funktionen är:

där:

Logistisk regression använder en ekvation som en representation, ungefär som linjär regression

Ingångsvärdena (x) kombineras linjärt med hjälp av vikter eller koefficientvärden för att förutsäga ett utgångsvärde (y). En viktig skillnad från linjär regression är att det modellerade utgångsvärdet är ett binärt värde (0 eller 1) snarare än ett numeriskt värde.

Här är ett exempel på en logistisk regressionsekvation:

y = e^(b0 + b1 * x) / (1 + e^(b0 + b1 * x))

Duva:

Varje kolumn i inmatningsdata har en tillhörande b-koefficient (ett konstant verkligt värde) som måste läras av träningsdata.

Den faktiska representationen av modellen som du lagrar i minnet eller en fil är koefficienterna i ekvationen (beta- eller b-värdet).

Logistisk regression modellerar sannolikheten för standardklassen.

Låt oss som ett exempel anta att vi modellerar människors kön som manlig eller kvinnlig från deras höjd, den första klassen kan vara manlig, och den logistiska regressionsmodellen kan skrivas som sannolikheten för att vara manlig med en persons höjd eller mer. formellt:

P (kön = hane | höjd)

Skrivet på ett annat sätt modellerar vi sannolikheten att en indata (X) tillhör klassen predefinite (Y = 1), kan vi skriva det som:

P(X) = P(Y = 1 | X)

Sannolikhetsförutsägelsen måste omvandlas till binära värden (0 eller 1) för att faktiskt göra en sannolikhetsförutsägelse.

Logistisk regression är en linjär metod, men förutsägelser omvandlas med den logistiska funktionen. Effekten av detta är att vi inte längre kan förstå förutsägelser som en linjär kombination av insatser som vi kan med linjär regression, till exempel, fortsätter ovanifrån, modellen kan uttryckas som:

p(X) = e ^ (b0 + b1 * X) / (1 + e ^ (b0 + b1 * X))

Nu kan vi vända ekvationen på följande sätt. För att vända det kan vi fortsätta genom att ta bort e på ena sidan genom att lägga till en naturlig logaritm på andra sidan.

ln (p (X) / 1 - p (X)) = b0 + b1 * X

På detta sätt får vi det faktum att beräkningen av utgången till höger är linjär igen (precis som linjär regression), och ingången till vänster är en logaritm för sannolikheten för standardklassen.

Sannolikheterna beräknas som ett förhållande mellan sannolikheten för händelsen dividerad med sannolikheten för ingen händelse, t.ex. 0,8 / (1-0,8) vars resultat är 4. Så vi kan istället skriva:

ln(odds) = b0 + b1 *

Eftersom sannolikheter är log-transformerade, kallar vi den här vänster-sidiga log-odds eller probit.

Vi kan återföra exponenten till höger och skriva den som:

sannolikhet = e ^ (b0 + b1 * X)

Allt detta hjälper oss att förstå att modellen fortfarande är en linjär kombination av indata, men att denna linjära kombination hänvisar till logsannolikheterna för preklassendefinita.

Koefficienterna (beta- eller b-värden) för den logistiska regressionsalgoritmen uppskattas i inlärningsfasen. För att göra detta använder vi maximal uppskattning av sannolikheten.

Maximal likelihood-uppskattning är en inlärningsalgoritm som används av flera maskininlärningsalgoritmer. Koefficienterna från modellen förutsäger ett värde mycket nära 1 (t.ex. Man) för preklassendefinite och ett värde mycket nära 0 (t.ex. hona) för den andra klassen. Maximal sannolikhet för logistisk regression är en procedur för att hitta värden för koefficienter (Beta- eller ob-värden) som minimerar felet i sannolikheterna som förutsägs av modellen i förhållande till de i datan (t.ex. sannolikhet 1 om data är den primära klassen) .

Vi kommer att använda en minimeringsalgoritm för att optimera de bästa koefficientvärdena för träningsdata. Detta implementeras ofta i praktiken med en effektiv numerisk optimeringsalgoritm.

Att utveckla finmotorik genom färgläggning förbereder barn för mer komplexa färdigheter som att skriva. Att färglägga…

Marinesektorn är en sann global ekonomisk makt, som har navigerat mot en marknad på 150 miljarder...

I måndags tillkännagav Financial Times ett avtal med OpenAI. FT licensierar sin journalistik i världsklass...

Miljontals människor betalar för streamingtjänster och betalar månatliga prenumerationsavgifter. Det är en allmän uppfattning att du...