მანქანათმცოდნეობა ფორმულირებულია, როგორც ზარალის ფუნქციის "მინიმიზაციის პრობლემები", მოცემული მაგალითების მაგალითზე (სასწავლო კომპლექტი). ეს მახასიათებელი გამოხატავს შეუსაბამობას ტრენინგის მოდელის მიერ პროგნოზირებულ ღირებულებებსა და თითოეული მაგალითის მაგალითზე მოსალოდნელ მნიშვნელობებს შორის.

საბოლოო მიზანია, რომ მოდელს ვასწავლოთ სწორად პროგნოზირების შესაძლებლობა იმ ინსტანციებზე, რომლებიც არ არის სასწავლო ნაკრებში.

მეთოდი, რომლის მიხედვითაც შესაძლებელია ალგორითმის სხვადასხვა კატეგორიის გამოყოფა, არის გამოსავლის ტიპი, რომელიც მოსალოდნელია გარკვეული სისტემისგან. მანქანა სწავლის.

მთავარ კატეგორიებს შორის ვხვდებით:

კლასიფიკაციის მაგალითია ერთი ან მეტი ეტიკეტის დანიშვნა გამოსახულების საფუძველზე, მასში შემავალი საგნების ან საგნების საფუძველზე;

რეგრესიის მაგალითია სცენის სიღრმის შეფასება მისი წარმოდგენიდან ფერადი გამოსახულების სახით.

სინამდვილეში, გამომავალი დომენის სფერო ფაქტობრივად უსასრულოა და არ შემოიფარგლება მხოლოდ გარკვეული დისკრეტული შესაძლებლობებით.

ხაზოვანი რეგრესია არის amფართოდ გამოყენებული მოდელი, რომელიც გამოიყენება რეალური ფასეულობების შესაფასებლად, როგორიცაა:

და მიჰყვება უწყვეტი ცვლადის კრიტერიუმს:

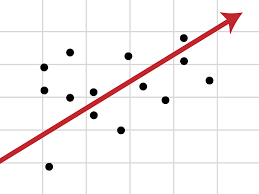

ხაზოვან რეგრესში, დამოუკიდებელ ცვლადებსა და დამოკიდებულ ცვლადებს შორის კავშირი ხდება ხაზის მეშვეობით, რომელიც ჩვეულებრივ წარმოადგენს ორ ცვლას შორის ურთიერთობას.

Fit line ცნობილია როგორც რეგრესიული ხაზი და წარმოდგენილია Y = a * X + b ტიპის ხაზოვანი განტოლებით.

ფორმულა ემყარება მონაცემების ინტერპრეტაციას, ორი ან მეტი მახასიათებლის ერთმანეთთან დაკავშირებას. ალგორითმის შეყვანის მახასიათებლის მიცემისას, რეგრესია სხვა მახასიათებელს უბრუნებს.

როდესაც ჩვენ გვაქვს ერთზე მეტი დამოუკიდებელი ცვლადი, მაშინ ჩვენ ვსაუბრობთ მრავალჯერადი ხაზოვანი რეგრესიის შესახებ, თუ ვივარაუდებთ მოდელს შემდეგნაირად:

y = ბ0 + ბ1x1 + ბ2x2 +… + ბnxn

ძირითადად, განტოლება ხსნის უწყვეტი დამოკიდებულ ცვლადს (y) და ორ ან მეტ დამოუკიდებელ ცვლადს (x1, x2, x3…) შორის ურთიერთობას.

მაგალითად, თუ გვსურს შევაფასოთ მანქანის CO2- ის ემისია (დამოკიდებული ცვლადი y) ძრავის სიმძლავრის, ცილინდრების რაოდენობის და საწვავის მოხმარების გათვალისწინებით. ეს უკანასკნელი ფაქტორები დამოუკიდებელი ცვლადია x1, x2 და x3. მუდმივი bi არის რეალური რიცხვები და უწოდებენ მოდელის სავარაუდო რეგრესიის კოეფიციენტებს. Y არის უწყვეტი დამოკიდებული ცვლადი, ანუ არის b0, b1 x1, b2 x2 და ა.შ. y იქნება ნამდვილი რიცხვი.

მრავალჯერადი რეგრესიული ანალიზი არის მეთოდი, რომელიც განსაზღვრავს გავლენას დამოუკიდებელ ცვლადებზე დამოკიდებულ ცვლადზე.

იმის გაგება, თუ როგორ იცვლება დამოკიდებული ცვლადი, როგორც დამოუკიდებელი ცვლადები იცვლება, საშუალებას გვაძლევს წინასწარ განვსაზღვროთ რეალურ სიტუაციებში ცვლილებების შედეგები ან ზემოქმედება.

მრავალჯერადი ხაზოვანი რეგრესიის გამოყენებით შესაძლებელია იმის გაგება, თუ როგორ იცვლება არტერიული წნევა, რადგან იცვლება სხეულის მასის ინდექსი, ფაქტორების გათვალისწინებით, როგორიცაა ასაკი, სქესი და ა.შ., რითაც ვარაუდობთ რა შეიძლება მოხდეს.

მრავალჯერადი რეგრესიით შეგვიძლია მივიღოთ შეფასებები ფასების ტენდენციებზე, მაგალითად, სამომავლო ტენდენცია ნავთობის ან ოქროსთვის.

დაბოლოს, მრავალრიცხოვანი ხაზოვანი რეგრესია უფრო მეტ ინტერესს იწვევს მანქანაში სწავლისა და ხელოვნური ინტელექტის სფეროში, რადგან ეს საშუალებას აძლევს მოაწყოს სწავლის მოდელები, თუნდაც დიდი ჩანაწერების გაანალიზების შემთხვევაში.

ლოგისტიკური რეგრესია არის სტატისტიკური ინსტრუმენტი, რომლის მიზანია ორიგინალური შედეგის მოდელირება ერთი ან მეტი განმარტებითი ცვლადით.

ის ზოგადად გამოიყენება ბინარული პრობლემებისთვის, სადაც მხოლოდ ორი კლასია, მაგალითად დიახ ან არა, 0 ან 1, კაცი ან ქალი და ა.შ. ...

ამ გზით შესაძლებელია მონაცემების აღწერა და ახსნა ორობითი დამოკიდებული ცვლადის და ერთი ან მეტი ნომინალური ან რიგის დამოუკიდებელი ცვლადის ურთიერთმიმართების ახსნა.

შედეგი განისაზღვრება ლოგისტიკური ფუნქციის გამოყენების წყალობით, რომელიც აფასებს ალბათობას და შემდეგ defiამთავრებს მიღებულ ალბათობის მნიშვნელობასთან უახლოეს კლასს (დადებითი ან უარყოფითი).

შეგვიძლია განვიხილოთ ლოგისტიკური რეგრესია, როგორც ოჯახის ოჯახის კლასიფიკაციის მეთოდი ზედამხედველობით სწავლის ალგორითმები.

სტატისტიკური მეთოდების გამოყენებით, ლოგისტიკური რეგრესია საშუალებას იძლევა შექმნას შედეგი, რომელიც, ფაქტობრივად, წარმოადგენს იმის ალბათობას, რომ მოცემული შეყვანის ღირებულება მიეკუთვნება მოცემულ კლასს.

ბინომალური ლოგისტიკური რეგრესიის პრობლემებში, ალბათობა, რომ გამომავალი ეკუთვნის ერთ კლასს, იქნება P, ხოლო რომ ის სხვა კლასს მიეკუთვნება 1-P (სადაც P არის 0 და 1 რიცხვს შორის, რადგან ეს გამოხატავს ალბათობას).

ბინომური ლოგისტიკური რეგრესია კარგად მუშაობს ყველა იმ შემთხვევაში, რომელშიც ცვლადი, რომლის ჩვენ პროგნოზირებასაც ვცდილობთ, არის ბინარული, ანუ მას შეუძლია მიიღოს მხოლოდ ორი მნიშვნელობა: მნიშვნელობა 1, რომელიც წარმოადგენს დადებით კლასს, ან 0 მნიშვნელობას, რომელიც წარმოადგენს უარყოფით კლასს.

პრობლემების მაგალითები, რომელთა მოგვარებაც შესაძლებელია ლოგისტიკური რეგრესიით, არის:

ლოგისტიკური რეგრესიით შეგვიძლია გავაკეთოთ პროგნოზირებადი ანალიზი, გავზომოთ ურთიერთობა, რისი პროგნოზირებაც გვინდა (დამოკიდებული ცვლადი) და ერთი ან მეტი დამოუკიდებელი ცვლადი, ანუ მახასიათებლები. ალბათობის შეფასება ხდება ლოგისტიკური ფუნქციის მეშვეობით.

ალბათობები შემდგომში გარდაიქმნება ბინარულ მნიშვნელობებში, და იმისთვის, რომ პროგნოზი რეალური გახდეს, ამ შედეგს ენიჭება კლასი, რომელსაც იგი მიეკუთვნება, იმის გათვალისწინებით, რამდენად ახლოსაა იგი თავად კლასში.

მაგალითად, თუ ლოგისტიკური ფუნქციის გამოყენება დააბრუნებს 0,85-ს, ეს ნიშნავს, რომ შეტანილი იქნა პოზიტიური კლასი მისი 1-ლი კლასის მინიჭებით. პირიქით, თუ მან მიიღო ისეთი მნიშვნელობა, როგორიცაა 0,4 ან ზოგადად <0,5 ..

ლოგისტიკური რეგრესია იყენებს ლოგისტიკურ ფუნქციას შეყვანის მნიშვნელობების კლასიფიკაციის შესაფასებლად.

ლოგისტიკური ფუნქცია, რომელსაც ასევე სიგმოიდს უწოდებენ, არის მრუდი, რომელსაც შეუძლია მიიღოს ნებისმიერი რაოდენობის რეალური მნიშვნელობა და შეაფასოს ის 0 – დან და 1 – მდე ღირებულებამდე, უკიდურესობის გამოკლებით. ფუნქციაა:

სად არის:

ლოგისტიკური რეგრესია იყენებს განტოლებას, როგორც რეპრეზენტაციას, ისევე როგორც ხაზოვანი რეგრესი

შეტანის მნიშვნელობები (x) ხაზთან არის შერწყმული წონების ან კოეფიციენტის მნიშვნელობების გამოყენებით, რათა განისაზღვროს გამომავალი მნიშვნელობა (y). ხაზოვანი რეგრესიისგან მთავარი განსხვავება ისაა, რომ მოდელირებული გამომავალი მნიშვნელობა არის ორობითი მნიშვნელობა (0 ან 1) ვიდრე ციფრული მნიშვნელობა.

ქვემოთ მოცემულია ლოგისტიკური რეგრესიის განტოლების მაგალითი:

y = e^(b0 + b1 * x) / (1 + e^(b0 + b1 * x))

სად:

შეყვანის მონაცემებში თითოეულ სვეტს აქვს ასოცირებული b კოეფიციენტი (მუდმივი რეალური მნიშვნელობა), რომელიც უნდა გაეცნოს ტრენინგის მონაცემებს.

მოდელის რეალური წარმოდგენა, რომელსაც მეხსიერებას ან ფაილს ინახავ, განტოლების კოეფიციენტებია (ბეტა ან ბ მნიშვნელობა).

ლოგისტიკური რეგრესია მოდერებს ასახავს ნაგულისხმევი კლასის ალბათობას.

მაგალითის სახით, დავუშვათ, რომ ჩვენ მამაკაცებს სქესის მიხედვით ვაფასებთ, როგორც კაცი ან ქალი მათი სიმაღლიდან, პირველი კლასი შეიძლება იყოს მამაკაცი, ხოლო ლოგისტიკური რეგრესიის მოდელი შეიძლება დაიწეროს, როგორც მამაკაცის ალბათობა, თუ მას აქვს სიმაღლე ან სხვა. ოფიციალურად:

P (სქესი = კაცი | სიმაღლე)

სხვაგვარად დაწერილი, ჩვენ მოდელირებთ ალბათობას, რომ შეყვანა (X) მიეკუთვნება კლასს predefinite (Y = 1), შეგვიძლია დავწეროთ როგორც:

P (x) = p (y = 1 | x)

ალბათობის პროგნოზი უნდა გადაკეთდეს ბინარულ მნიშვნელობებში (0 ან 1) იმისათვის, რომ რეალურად გააკეთოთ ალბათობის პროგნოზი.

ლოგისტიკური რეგრესია არის წრფივი მეთოდი, მაგრამ პროგნოზები გარდაიქმნება ლოგისტიკური ფუნქციის გამოყენებით. ამის გავლენა იმაში მდგომარეობს, რომ ჩვენ აღარ შეგვიძლია გვესმოდეს პროგნოზები, როგორც შეყვანის ხაზოვანი კომბინაცია, როგორც ეს შეგვიძლია წრფივი რეგრესიით, მაგალითად, ზემოდან გაგრძელებით, მოდელი შეიძლება გამოითქვას, როგორც:

p (x) = e ^ (b0 + b1 * x) / (1 + e ^ (b0 + b1 * x))

ახლა ჩვენ შეგვიძლია გადავადოთ განტოლება შემდეგნაირად. ამის გადასაწყვეტად ჩვენ შეგვიძლია გავაგრძელოთ e – ის ამოღება ერთი მხრიდან, მეორე მხარეს ბუნებრივი ლოგარითმის დამატებით.

ln (p (X) / 1 - p (X)) = b0 + b1 * X

ამ გზით ვიღებთ იმ ფაქტს, რომ გამოშვების გამოთვლა მარჯვნივ არის წრფივი (ისევე, როგორც ხაზოვანი რეგრესია), ხოლო მარცხენა შეყვანა წარმოადგენს ნაგულისხმევი კლასის ალბათობის ლოგარითმას.

ალბათობები გამოითვლება, როგორც მოვლენის ალბათობის თანაფარდობა, რომელიც იყოფა რაიმე მოვლენის ალბათობაზე, მაგ. 0,8 / (1-0,8), რომლის შედეგია 4. ასე რომ, ჩვენ შეგვიძლია დავწეროთ:

ln (შანსები) = b0 + b1 * X

იმის გამო, რომ ალბათობები ლოგურად გარდაიქმნება, ჩვენ ვუწოდებთ ამ მარცხენა ლოგიკურ შანსს ან გამოსაცდელს.

ჩვენ შეგვიძლია დავაბრუნოთ ექსპონენტი მარჯვნივ და დავწეროთ ის, როგორც:

ალბათობა = e ^ (b0 + b1 * X)

ეს ყველაფერი გვეხმარება გავიგოთ, რომ მოდელი ნამდვილად არის შეყვანის წრფივი კომბინაცია, მაგრამ ეს წრფივი კომბინაცია ეხება წინა კლასის ლოგის ალბათობებს.defiნიტა.

ლოგისტიკური რეგრესიის ალგორითმის კოეფიციენტები (ბეტა ან ბ მნიშვნელობები) შეფასებულია სასწავლო ეტაპზე. ამისათვის ჩვენ ვიყენებთ მაქსიმალური ალბათობის შეფასებას.

მაქსიმალური ალბათობის შეფასება არის სწავლის ალგორითმი, რომელსაც იყენებს მანქანური სწავლების რამდენიმე ალგორითმი. მოდელის შედეგად მიღებული კოეფიციენტები პროგნოზირებენ მნიშვნელობას 1-თან ძალიან ახლოს (მაგ. მამრობითი) სკოლამდელი კლასისთვის.definite და მნიშვნელობა 0-თან ძალიან ახლოს (მაგ. ქალი) სხვა კლასისთვის. ლოგისტიკური რეგრესიის მაქსიმალური ალბათობა არის კოეფიციენტების (ბეტა ან ob მნიშვნელობები) მნიშვნელობების პოვნის პროცედურა, რომელიც ამცირებს შეცდომას მოდელის მიერ პროგნოზირებულ ალბათობებში მონაცემებთან შედარებით (მაგ. ალბათობა 1, თუ მონაცემები პირველადი კლასია). .

ჩვენ გამოვიყენებთ მინიმიზაციის ალგორითმს, სასწავლო მონაცემების საუკეთესო კოეფიციენტის მნიშვნელობების გასაუმჯობესებლად. ეს ხშირად ხორციელდება პრაქტიკაში, რიცხვითი ოპტიმიზაციის ეფექტური ალგორითმის გამოყენებით.

საზღვაო სექტორი ნამდვილი გლობალური ეკონომიკური ძალაა, რომელიც 150 მილიარდი ბაზრისკენ მიისწრაფვის...

გასულ ორშაბათს, Financial Times-მა გამოაცხადა გარიგება OpenAI-თან. FT ლიცენზირებს თავის მსოფლიო დონის ჟურნალისტიკას…

მილიონობით ადამიანი იხდის სტრიმინგის სერვისებს, იხდის ყოველთვიურ სააბონენტო გადასახადს. გავრცელებული აზრია, რომ თქვენ…

Coveware by Veeam გააგრძელებს კიბერ გამოძალვის ინციდენტებზე რეაგირების სერვისების მიწოდებას. Coveware შემოგთავაზებთ სასამართლო ექსპერტიზისა და გამოსწორების შესაძლებლობებს…