Masinõpe on sõnastatud kui kaotusfunktsiooni "minimeerimisprobleemid" antud näidete komplekti (koolituskomplekti) suhtes. See funktsioon väljendab erinevust koolitatava mudeli ennustatud väärtuste ja iga näiteootuse eeldatavate väärtuste vahel.

Lõppeesmärk on õpetada mudelile võimet ennustada õigesti eksemplare, mis treeningkomplektis puuduvad.

Meetod, mille järgi on võimalik eristada erinevaid algoritmide kategooriaid, on väljundi tüüp, mida teatud süsteemilt oodatakse. masinõpe.

Peamiste kategooriate hulgast leiame:

Klassifikatsiooni näide on ühe või mitme sildi omistamine pildile, mis põhineb sellel sisalduvatel objektidel või objektidel;

Regressiooni näide on stseeni sügavuse hindamine selle kujutise põhjal värvipildi kujul.

Tegelikult on vaadeldava väljundi valdkond praktiliselt lõpmatu ega piirdu teatud diskreetsete võimaluste kogumiga;

Lineaarne regressioon on amlaialdaselt kasutatav mudel, mida kasutatakse tegelike väärtuste hindamiseks, näiteks:

ja järgib pidevate muutujate kriteeriumi:

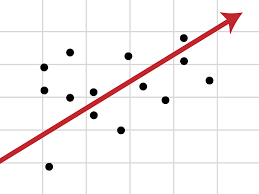

Lineaarse regressiooni korral järgitakse suhet sõltumatute ja sõltuvate muutujate vahel läbi joone, mis tavaliselt tähistab kahe muutuja vahelist suhet.

Sobivat joont nimetatakse regressioonisirgeks ja seda esindab tüüpi Y = a * X + b lineaarvõrrand.

Valem põhineb andmete interpoleerimisel, et seostada omavahel kaks või enam tunnust. Kui annate algoritmile sisendkarakteristiku, tagastab regressioon teise tunnuse.

Kui meil on rohkem kui üks sõltumatu muutuja, siis räägime mitmest lineaarsest regressioonist, eeldades järgmist mudelit:

y=b0 + b1x1 + b2x2 +… + Bnxn

Põhimõtteliselt selgitab võrrand seost pideva sõltuva muutuja (y) ja kahe või enama sõltumatu muutuja (x1, x2, x3…) vahel.

Näiteks kui tahaksime hinnata auto süsinikdioksiidi emissiooni (sõltuv muutuja y), võttes arvesse mootori võimsust, silindrite arvu ja kütusekulu. Need viimased tegurid on sõltumatud muutujad x2, x1 ja x2. Konstandid bi on reaalarvud ja neid nimetatakse mudeli hinnangulisteks regressioonikoefitsientideks.Y on pidev sõltuv muutuja, st on b3, b0 x1, b1 x2 jne summa. y on reaalarv.

Mitme regressioonanalüüsi abil saab tuvastada sõltumatute muutujate mõju sõltuvale muutujale.

Mõistmine, kuidas sõltuv muutuja muutub sõltumatute muutujatena, võimaldab meil ennustada muutuste mõjusid või mõjusid tegelikes olukordades.

Mitme lineaarse regressiooni abil on võimalik mõista, kuidas vererõhk muutub kehamassiindeksi muutumisel, võttes arvesse selliseid tegureid nagu vanus, sugu jne, eeldades seega, mis võib juhtuda.

Mitme regressiooni korral võime saada hinnanguid hinnasuundumuste kohta, näiteks nafta või kulla tuleviku trendid.

Lõpuks on mitmekordne lineaarne regressioon suurenenud huvi masinõppe ja tehisintellekti vastu, kuna see võimaldab saada toimivaid õpimudeleid isegi suure hulga analüüsitavate kirjete korral.

Logistiline regressioon on statistiline tööriist, mille eesmärk on modelleerida binoomitulem ühe või mitme selgitava muutujaga.

Seda kasutatakse tavaliselt binaarsete probleemide korral, kus on ainult kaks klassi, näiteks jah või ei, 0 või 1, mees või naine jne ...

Sel viisil on võimalik andmeid kirjeldada ja selgitada seost binaarse sõltuva muutuja ja ühe või mitme nominaalse või ordinaalse sõltumatu muutuja vahel.

Tulemus määratakse tänu logistilise funktsiooni kasutamisele, mis hindab tõenäosust ja seejärel defilõpetab saadud tõenäosusväärtusele lähima klassi (positiivne või negatiivne).

Logistlikku regressiooni saame pidada perekonna klassifitseerimise meetodiks juhendatud õppe algoritmid.

Statistilisi meetodeid kasutades võimaldab logistiline regressioon luua tulemuse, mis tegelikult kujutab tõenäosust, et antud sisendväärtus kuulub antud klassi.

Binoomsete logistiliste regressiooniprobleemide korral on tõenäosus, et väljund kuulub ühte klassi, P, samas kui see kuulub teise klassi 1-P (kus P on arv vahemikus 0 kuni 1, kuna see väljendab tõenäosust).

Binoomiline logistiline regressioon töötab hästi kõigil neil juhtudel, kui muutuja, mida proovime ennustada, on binaarne, see tähendab, et see võib eeldada ainult kahte väärtust: väärtus 1, mis tähistab positiivset klassi, või väärtus 0, mis tähistab negatiivset klassi.

Näited probleemidest, mida saab lahendada logistilise regressiooniga:

Logistilise regressiooni abil saame teha ennustavat analüüsi, mõõtes seost ennustatava (sõltuva muutuja) ja ühe või mitme sõltumatu muutuja, st karakteristikute vahel. Tõenäosuse hindamine toimub logistilise funktsiooni kaudu.

Seejärel teisendatakse tõenäosused binaarseteks väärtusteks ja ennustuse tegelikuks muutmiseks omistatakse see tulemus klassile, kuhu ta kuulub, lähtudes sellest, kas see on klassi enda lähedal või mitte.

Näiteks kui logistilise funktsiooni rakendamine tagastab 0,85, tähendab see, et sisend on loonud positiivse klassi, määrates selle klassile 1. Vastupidi, kui see oleks saanud sellise väärtuse nagu 0,4 või üldisemalt <0,5 ..

Logistiline regressioon kasutab sisendväärtuste klassifikatsiooni hindamiseks logistilist funktsiooni.

Logistiline funktsioon, mida nimetatakse ka sigmoidiks, on kõver, mis suudab võtta suvalise arvu tegelikke väärtusi ja kaardistada see väärtuseks vahemikus 0 kuni 1, välja arvatud äärmused. Funktsioon on:

kus see on:

Logistiline regressioon kasutab võrrandit esitusena, sarnaselt lineaarse regressiooniga

Sisendväärtused (x) ühendatakse lineaarselt, kasutades kaalu või koefitsientide väärtusi, et prognoosida väljundväärtust (y). Oluline erinevus lineaarsest regressioonist on see, et modelleeritud väljundväärtus on arvväärtuse asemel kahendväärtus (0 või 1).

Allpool on näide logistilise regressioonivõrrandist:

y = e^(b0 + b1 * x) / (1 + e^(b0 + b1 * x))

Tuvi:

Igal sisendandmete veerul on seotud b-koefitsient (püsiv tegelik väärtus), mida tuleb koolitusandmetest õppida.

Selle mudeli tegelik esitus, mida soovite mällu või faili salvestada, on võrrandi koefitsiendid (beeta- või b-väärtus).

Logistiline regressioon modelleerib vaikeklassi tõenäosust.

Oletame näiteks, et modelleerime inimeste sugu mees- või naissoost nende kõrguse järgi, esimene klass võiks olla mees ja logistiline regressioonimudel võiks olla kirjutatud kui tõenäosus, et mees on mees, arvestades inimese pikkust või rohkem. ametlikult:

P (sugu = mees | pikkus)

Teistmoodi kirjutatuna modelleerime tõenäosust, et sisend (X) kuulub klassi predefinite (Y = 1), saame selle kirjutada järgmiselt:

P(X) = P(Y = 1 | X)

Tõenäosuse ennustus tuleb teisendada binaarseteks väärtusteks (0 või 1), et tõenäosuse ennustust tegelikult teha.

Logistiline regressioon on lineaarne meetod, kuid ennustusi teisendatakse logistilist funktsiooni kasutades. Selle tagajärg on see, et me ei saa enam mõista ennustusi kui sisendite lineaarset kombinatsiooni, näiteks lineaarse regressiooniga, näiteks ülalt jätkates võib mudelit väljendada järgmiselt:

p(X) = e ^ (b0 + b1 * X) / (1 + e ^ (b0 + b1 * X))

Nüüd saame võrrandi ümber pöörata järgmiselt. Selle tagasipööramiseks võime eemaldada ühelt küljelt e, lisades teisele küljele naturaalse logaritmi.

ln (p (X) / 1 - p (X)) = b0 + b1 * X

Sel viisil saame tõsiasja, et paremal asuva väljundi arvutamine on jälle lineaarne (nagu ka lineaarne regressioon) ja vasakpoolsel sisendil on vaikeklassi tõenäosuse logaritm.

Tõenäosused arvutatakse sündmuse tõenäosuse suhtena jagatud sündmuse puudumise tõenäosusega, nt. 0,8 / (1-0,8), mille tulemus on 4. Seega võiksime selle asemel kirjutada:

ln (koefitsient) = b0 + b1 * X

Kuna tõenäosused on log-teisendatud, nimetatakse seda vasakpoolseks log-koefitsiendiks või probitiks.

Võime eksponendi paremale tagasi saata ja kirjutada järgmiselt:

tõenäosus = e ^ (b0 + b1 * X)

Kõik see aitab meil mõista, et mudel on tõepoolest ikkagi sisendite lineaarne kombinatsioon, kuid see lineaarne kombinatsioon viitab eelklassi logaritmilistele tõenäosustele.definita.

Logistilise regressiooni algoritmi koefitsiente (beeta- või b-väärtusi) hinnatakse õppefaasis. Selleks kasutame maksimaalse tõenäosuse hindamist.

Maksimaalse tõenäosuse hinnang on õppimisalgoritm, mida kasutavad mitmed masinõppealgoritmid. Mudelist tulenevad koefitsiendid ennustavad eelklassi jaoks 1-le väga lähedast väärtust (nt meessoost).definite ja 0-le väga lähedane väärtus (nt naissoost) teise klassi jaoks. Logistilise regressiooni maksimaalne tõenäosus on protseduur koefitsientide (beeta- või ob-väärtuste) väärtuste leidmiseks, mis minimeerivad mudeli ennustatud tõenäosuste vea võrreldes andmetes leiduvate tõenäosustega (nt tõenäosus 1, kui andmed on põhiklass). .

Treeningandmete parimate koefitsientide väärtuste optimeerimiseks kasutame minimeerimise algoritmi. Seda rakendatakse praktikas sageli tõhusa arvulise optimeerimise algoritmi abil.

Veeami Coveware jätkab küberväljapressimise juhtumitele reageerimise teenuste pakkumist. Coveware pakub kohtuekspertiisi ja heastamisvõimalusi…

Ennustav hooldus muudab nafta- ja gaasisektori pöördeliseks uuendusliku ja ennetava lähenemisega tehaste juhtimisele.…

Ühendkuningriigi CMA on väljastanud hoiatuse Big Techi käitumise kohta tehisintellekti turul. Seal…

Euroopa Liidu poolt hoonete energiatõhususe suurendamiseks koostatud roheliste majade dekreet on lõpetanud oma seadusandliku protsessi…